The Take It Down Act: What It Means for Celebrity Deepfakes(AI 시대, 딥페이크 포르노와의 전면전)

생성 AI 시대가 도래하며 ‘딥페이크(Deepfake)’ 기술은 그 어느 때보다 강력하고, 동시에 위험해졌다. 온라인상에서 특정인의 신체 일부나 얼굴을 합성해 노골적인 장면을 만들어내는 ‘딥페이크 포르노’는 이미 심각한 사회 문제다.

이와 관련 최근 ‘ 이런 비동의 사적 이미지(Non-Consensual Intimate Imagery, NCII) 문제를 해결하기 위해 법안이 제정됐다. 테이크 잇 다운(Take It Down)법’은 연방 차원에서 본격적으로 칼을 빼든 첫 사례로 주목받고 있다. 이 법에 따르면 유명인이든 일반인이든 상관없이, 내 동의 없이 만들어지거나 공개된 노골적 이미지·영상은 이제 강력한 규제의 대상이 된다. 법이 발효되면 플랫폼들은 NCII 콘텐츠를 신고받은 후 최대 48시간 내에 삭제해야 할 의무가 생기고, 불응할 경우 FTC(연방거래위원회) 제재를 받게 된다.

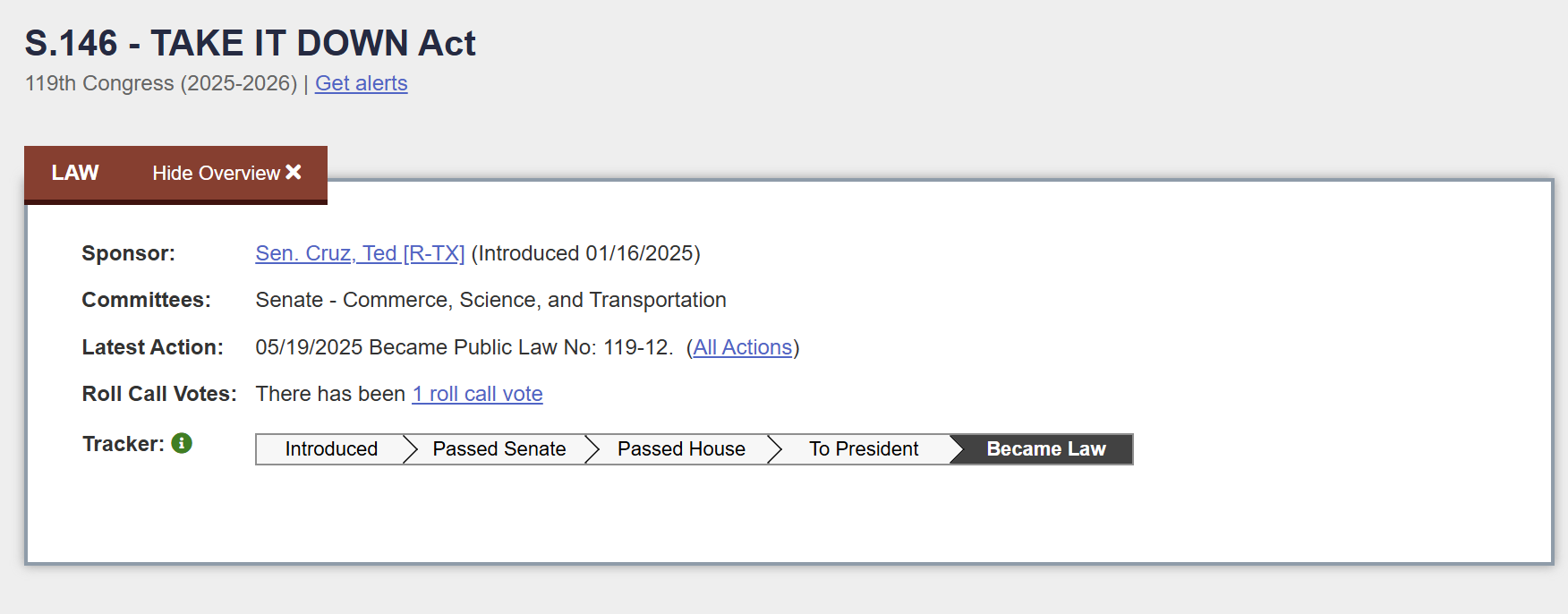

지난 5월 19일, 트럼프 대통령은 동의 없는 친밀한 이미지(NCII) 확산 방지를 목표로 하는 테이크 잇 다운 법(Take It Down Act)에 서명했다. 비동의 사적 이미지(Non-Consensual Intimate Imagery, NCII)란 본인의 동의 없이 온라인에 게시되거나 유포되는 노출·성적 영상·이미지를 말한다. 이 법은 실제 이미지와 비디오뿐만 아니라 생성 AI에 의해 생성되거나 조작되어 실제 인물의 모습을 담고 있는 "디지털 위조물" 또는 딥페이크도 규제한다. 아래 기사는 버라이어티의 표와 기사 등을 참조해 작성됐습니다.

The Take It Down Act: What It Means for Celebrity Deepfakes

The law provides recourse for celebrities and ordinary people as generative AI has scaled non-consensual intimate imagery (NCII) online. The act is expected to make NCII takedowns more effective, compel non-compliant platforms, and shut down deepfake porn sites.

On May 19, President Trump signed the Take It Down Act into law, which aims to prevent the spread of non-consensual intimate imagery (NCII). The act addresses both real images and videos as well as "digital forgeries" or deepfakes that have been created or manipulated by generative AI and contain real people's likenesses.

Targeting harms including revenge porn and explicit deepfakes, Take It Down is officially known as the Tools to Address Known Exploitation by Immobilizing Technological Deepfakes on Websites and Networks Act. Currently a state-level patchwork, the act fills a legislative gap against NCII at the federal level. Additional regulation is in progress to address deepfake content of individuals more broadly, notably the No Fakes Act.

Key Provisions

Take It Down makes it a federal crime for any person to knowingly post non-consensual "intimate visual depictions" of others, with penalties that could include fines and/or up to three years in prison. It requires covered online platforms to remove reported content upon request within 48 hours, with civil penalties for those failing to comply enforceable by the FTC. The notice and removal requirements for covered platforms don't take effect until May 19, 2026.

The law has become critically needed as generative AI has scaled the non-consensual deepfake problem into a crisis with little recourse for victims, who include public figures as well as non-famous people, including children, teens, and disproportionately, women. Among the act's endorsers was SAG-AFTRA, which has been consistently fighting for regulation to protect its members from AI harms, whether inside or outside the workplace.

Luke Arrigoni, CEO at Loti, a deepfake detection and takedown service that works primarily with public figures, stated, "It's crazy we've gotten this far into the internet and we're just now making it a law that says if it's you in an explicit situation, you get to say whether that stays up published or not."

Expected Initial Outcomes

First, it creates a more direct path to NCII takedowns on major public platforms. Having a law that specifically addresses NCII makes it easier and faster for victims to get takedowns, as it compels platforms to take action quickly on requests. Josh Weigensberg, IP litigation partner at Pryor Cashman, explained, "This is giving victims real recourse and mechanisms to get this stuff off of online platforms."

Second, it compels platforms that haven't previously complied. Arrigoni noted, "Take It Down has been really effective for platforms that didn't want to work with us. Most sites have been compliant, even the most nefarious ones, but it's sites like X that we've had to use the Take It Down Act for. Now we have a superpower with them."

Third, it compels platforms to proactively ban NCII. Multiple 404 Media reports have detailed how the popular AI model hosting and sharing site Civitai allows users to AI-generate non-consensual pornographic images and videos as well as share LoRAs (custom AI models) of real-world celebrities.

Fourth, it squashes sites intentionally distributing NCII. Just days after Congress passed Take It Down, the prominent deepfake porn site MrDeepFakes, on which the vast majority of content was NCII deepfake videos featuring celebrities, shut down.

Concerns and Criticisms

Advocacy groups have criticized the law, arguing it will enable overreach, censorship, and selective enforcement while undermining user privacy. Some speculate Trump would end up trying to abuse the law to censor negative speech about him, as he hinted in a speech to Congress earlier this year.

Other concerns include that platforms aligned with the administration would "feel emboldened to simply ignore" takedown requests, automated systems used to identify NCII for removal are faulty and tend to suppress lawful speech, rampant "false reports" would swarm platforms and hurt their ability to operate, and end-to-end encrypted (E2EE) messaging services could be forced to expose users' private messages to comply.

Some of these critiques will need to be addressed. For example, language in the act doesn't explicitly list E2EE services under excluded platforms, meaning they might indeed be considered covered platforms. It's further possible that some platforms won't comply, at which point it will be up to the FTC to bring cases against them.

Weigensberg stated, "I expect we'll see some refinement [of the law] in the future for a victim that tries to get non-consensual images taken down from a site and the site isn't complying. The act is clear that the FTC can step in and help, but we're looking at options the victim would have in that scenario, additional steps he or she could take."

Yet free-speech concerns feel abstracted from the reality of NCII online, which the law is narrowly scoped to deter, disincentivize, and help real victims remove.

Weigensberg added, "Some of these First Amendment concerns presuppose that bad actors are going to abuse the notice and takedown process that's designed to help victims of deepfake pornography and sharing of other non-consensual intimate images. There are so many victims of deepfake pornography and other non-consensual intimate images being shared, and they need tools to be able to fight it. This seems like a very good one."

‘테이크 잇 다운(Take It Down)법’

이 법의 정식 명칭은 ‘Tools to Address Known Exploitation by Immobilizing Technological Deepfakes on Websites and Networks Act)이다. 법안의 주요 내용은 이렇다.

- 비동의 친밀 이미지(NCII): 피해자 본인의 동의 없이 온라인에 게시·유포되는 성적 이미지·영상 전반을 가리키며, 복수 포르노(revenge porn), 노골적인 합성물(딥페이크)도 포함한다.

- 처벌 수위: 위반 시 벌금 또는 최대 3년 형사처벌이 가능하다.

- 콘텐츠 삭제 의무: 법에서 정한 ‘플랫폼’에 해당하는 웹사이트나 소셜미디어 등은 NCII 콘텐츠 신고가 접수되면 48시간 안에 삭제해야 하고, 이를 어길 경우 FTC가 민사 처벌을 내릴 수 있다.

- 시행 시점: 플랫폼들이 이 ‘삭제 의무’를 본격적으로 준수해야 하는 시기는 2026년 5월 19일부터다.

왜 지금 이 법이 필요한가?

- 생성 AI의 급격한 발전: 소수 전문가만 가능하던 딥페이크 제작이 이제는 누구나 온라인에서 쉽게 관련 툴과 모델을 구해 만들 수 있을 정도로 보편화되었다.

- 피해 규모의 폭증: 특히 여성 연예인이나 여성 일반인들이 그 표적이 되기 쉽고, 2차·3차 유포가 빠르게 진행되는 특성상 한 번 퍼지면 회복이 어렵다.

- 기존 법률 공백: 일부 주(州)에서 비동의 친밀 이미지를 규제하는 조항이 있었으나, 연방 차원에선 명시적 보호법이 미비했던 상황이다.

딥페이크 시대를 겨냥한 강력한 규제

‘테이크 잇 다운 법’은 NCII 전반을 규제하면서도 딥페이크 문제에 초점을 맞추고 있다는 점이 특징이다. 가짜 음란물 제작·유포가 디지털 위조(digital forgeries)”라는 명칭으로 분류되어, 실제 피해자가 촬영에 참여하지 않았어도(합성이어도) 성적 이미지로서 본인의 초상·신체가 사용됐다면 법적 규제를 가한다.

루크 아리고니(Luke Arrigoni), 딥페이크 탐지·삭제 서비스 로티(Loti) CEO는 버라이어티와의 인터뷰에서 “인터넷이 이렇게까지 발전하는 동안, 피해자가 ‘내가 등장하는 노골적 이미지’에 대해 거부권을 행사할 수 있다는 기본 법률조차 제대로 없었다는 점이 더욱 놀라웠다’고 강조했다.

NCII 삭제 절차가 더 쉬워진다

이 법은 플랫폼들이 피해자의 NCII 신고에 빠르고 직접적으로 대응하도록 만든다. 예컨대 기존에는 각 플랫폼 이용약관이나 커뮤니티 가이드라인에 의존해 “이건 명백히 문제이니 삭제해 달라”고 요청했어야 했다. 하지만 이제는 *것은 연방법 위반”임을 내세울 수 있게 됐다.

- 시간제한(48시간): 법이 정한 삭제 기한이 존재하기 때문에 플랫폼 입장에서는 신고 처리 속도를 늦출 수 없다.

- 제재 수단 강화: 불응하는 플랫폼에 대해서는 FTC가 민사 소송을 제기할 수 있고, 이러한 집행이 현실화되면 기업 입장에서 막대한 벌금이나 법적 분쟁 비용이 발생한다.

미국 행정부는 딥페이크 콘텐츠에 대한 추가 규제가 진행 중이며, 특히 페이크 금지법을 통해 보다 광범위하게 페이크 콘텐츠에 대한 규제를 강화할 계획이다. (No Fakes Act)

출처 버라이어티

설문 조사 결과 미국 성인 대다수는 합성 비동의 사적 이미지(성적 합성물)가 신고 즉시 삭제되어야 한다고 생각하 제작·유포자에 대한 형사처벌에도 높은 찬성(69%)을 보이고 있다.

‘나몰라라’ 하던 플랫폼들도 압박

아리고니 CEO는 “평소 대다수 플랫폼은 이런 ‘비동의 이미지’ 신고가 들어오면 대체로 협조적이었지만, 트위터(X)처럼 예외적인 곳이 있었다”고 지적한다.

이제 테이크 잇 다운 법이라는 강제 조항이 생기면서, 그간 대응이 느슨했던 곳들도 본격적으로 협조하거나 새로운 NCII 방지 정책을 도입할 것으로 보인다.

테이크 잇 다운 법은 타인의 동의 없는 "친밀한 시각적 묘사(intimate visual depictions)"를 고의로 게시하는 것을 연방 범죄로 규정하며, 위반 시 벌금 및/또는 최대 3년의 징역형에 처할 수 있다. 또한 해당 온라인 플랫폼은 신고된 콘텐츠를 요청 후 48시간 이내에 삭제해야 하며, 이를 준수하지 않을 경우 FTC가 집행할 수 있는 민사 처벌을 받게 된다. 플랫폼에 대한 통지 및 삭제 요구 사항은 2026년 5월 19일부터 발효된다.

유명인 딥페이크 포르노 사이트 폐쇄 가속화

생성 AI 모델이 보편화되면서, 유명인의 얼굴이나 목소리를 무단으로 합성해 음란물로 만드는 전문 사이트가 우후죽순 생겨났다. 대표적으로 ‘MrDeepFakes’라는 웹사이트는 연예인 딥페이크 포르노의 온상이었는데, 이 법이 의회를 통과한 직후 결국 폐쇄를 결정했다.

- 운영 리스크 증가: 만약 계속 같은 형태로 사이트를 운영할 경우, “NCII를 전문적으로 유포하는 플랫폼”이라는 법적 정의에 해당해 바로 민·형사 처벌을 받을 가능성이 높아진다.

- 타 딥페이크 공유 커뮤니티에도 파장: Civitai 같은 딥페이크 생성 모델(LoRA) 공유 사이트는 물론, Reddit·Discord 등에서도 비동의 이미지를 다루는 커뮤니티가 대폭 축소되거나 폐쇄될 것으로 전망된다.

연예인 딥페이크 피해 현황: 직업 및 성별별

| 구분 | 배우 | 운동선수 | 기업인 | 인터넷 인플루언서 | 뮤지션 | 정치인 |

|---|---|---|---|---|---|---|

| NCII 딥페이크 – 여성 | 1,339 | 3 | 41 | 2 | 263 | 9 |

| NCII 딥페이크 – 남성 | 11 | 0 | 8 | 0 | 0 | 0 |

| 비-NCII 딥페이크 – 여성 | 1,302 | 556 | 83 | 52 | 612 | 10 |

| 비-NCII 딥페이크 – 남성 | 2,470 | 236 | 1,045 | 22 | 448 | 3 |

주: NCII(비동의 성적 이미지) 딥페이크와 비-NCII(비성적 합성) 딥페이크로 구분됨. 2024년 12월 기준 45명의 유명인 대상 데이터.

조사에 따르면 여성 배우는 NCII(비동의 성적 이미지) 딥페이크 피해가 1,339건으로, 전체 여성 피해 중 압도적으로 높은 비중을 차지한다. 뮤지션(263건)도 뒤를 잇는다. 반면, 남성은 NCII 딥페이크 피해가 극히 적다(최대 11건).

SAG-AFTRA 등 엔터테인먼트 업계 지지

배우·가수·연예인들을 대표하는 미국영화배우조합(SAG-AFTRA)은 테이크 잇 다운 법을 열렬히 지지해왔다. 공인이 실제 촬영에 전혀 참여하지 않았는데도, 가짜 음란물이 마치 진짜처럼 퍼져나가는 상황이 만연하기 때문이다. AI확산으로 가장 많은 피해를 보고 있는 직군 하나인 미국 배우 조합은(SAG-AFTRA)은 이 법을 즉각 지지했다.

- 연예인의 초상·음성권 보호: AI가 빠르게 발전하며 스타들의 얼굴·목소리를 무단 복제하는 일이 흔해진 만큼, 향후 연예인노조를 비롯한 업계가 딥페이크 규제를 위한 추가 입법을 지속적으로 요구할 것으로 보인다.

- ‘No Fakes Act’ 등 추가 입법: 현재 의회에 계류된 다른 법안들 역시 AI를 통한 명예훼손 및 초상권 침해 행위를 전면 금지하려는 내용을 담고 있어, 테이크 잇 다운 법과 함께 더욱 강화된 보호체계가 만들어질 전망이다.

비판·우려: 검열 남용 및 사생활 침해 가능성?

테이크 잇 다운 법이 가진 ‘분명한 의의’에도 불구하고, 일부 옹호단체나 전문가들은 다음과 같은 문제점도 있다.

- 정치적 악용

트럼프 전 대통령이 과거 연설에서 “자신에게 불리한 발언이나 이미지를 법을 통해 검열할 수 있다”는 취지로 암시했다는 보도가 있었다. 실제로 이 법을 근거로, 권력자가 ‘음란물’로 몰거나 부당한 딥페이크 판정을 내려 비판적 이미지를 삭제하게 만들 우려가 제기된다. - 잘못된 머신러닝 필터링

플랫폼이 NCII를 찾고 제거하는 데 자동화된 AI 필터링(Automated (machine learning) systems)을 사용할 경우, 오류가 발생해 합법적 표현물까지 삭제될 가능성이 있다. 즉, 시스템이 “노출이 과도한 것 같다” 판단해 걸러내는 과정에서 피해가 커질 수 있다는 지적이다. - 거짓 신고 남발

경쟁사나 악의적인 집단이 특정 인물이나 단체를 공격하기 위해 ‘비동의 이미지를 게시했다’며 허위 신고(false reports)를 반복할 경우, 대량의 신고가 접수되어 플랫폼 운영에 부담이 생기고 정당한 콘텐츠까지 차단될 수 있다. - E2EE(종단 간 암호화) 서비스 포함 문제

해당 법 조항에 텔레그램, Signal, WhatsApp 등 ‘종단 간 암호화’를 제공하는 개인·단체 채팅 앱이 명시적으로 제외된 것은 아니다. 이 때문에 이들 앱이 법적 “커뮤니케이션 플랫폼”으로 분류되어, 유포되는 NCII를 삭제하려면 결국 암호화 해제나 대화 내용 검열 등이 필요해질 수 있다는 우려가 있다.

조쉬 웨이겐스버그(Josh Weigensberg), 프라이어 캐시먼 IP 소송 파트너는 “이 법은 딥페이크 포르노나 기타 비동의 친밀 이미지의 피해자들을 보호하기 위해 마련됐다”며 “하지만, 그 삭제 절차가 악용되거나 자의적으로 남용될 것이라는 지적이 계속된다. 시행 과정에서 세부적인 조정이 필요할 것”이라고 언론 인터뷰에서 지적했다.

적용 및 향후 전망

1)실질적 피해 구제 가능성

법률 전문가들은 이번 법이 시행되면, 적어도 대형 플랫폼에서 NCII가 무차별적으로 퍼지는 상황을 어느 정도 억제할 수 있을 것으로 보고 있다. 현행법으로는 단순히 ‘사적인 명예훼손’ 혹은 ‘저작권 침해’ 등으로 우회 소송을 걸어야 했던 과거와 달리, “비동의 포르노·딥페이크 자체가 명백히 불법”임을 직접 주장할 수 있기 때문이다. NCII를 구체적으로 다루는 법이 있으면 플랫폼이 요청에 신속하게 조치를 취하도록 강제하기 때문에 피해자가 더 쉽고 빠르게 게시물을 삭제할 수 있다. 이 법은 피해자들에게 온라인 플랫폼에서 이러한 콘텐츠를 삭제할 수 있는 실질적인 수단과 메커니즘을 제공한다.

아울러 이 법이 이메일과 같은 사적인 온라인 공간에서 NCII를 생성하거나 공유하는 것을 막지는 못하지만, 많은 사람들이 가장 우려하는 공용 인터넷에서의 확산에 직접적으로 대처할 수 있게 됐다. 이 법에 정의된 적용 대상 플랫폼에는 소셜 미디어(즉, 대중에게 서비스를 제공하고 "주로 사용자 제작 콘텐츠를 위한 포럼을 제공하는" 웹사이트, 서비스 또는 앱)가 포함되다.

영국 성인의 딥페이크 온라인 대응 방안 인식

| 대응 방안 | 비율 |

|---|---|

| 유해 딥페이크 제작·유포를 불법화하는 엄격한 입법 | 72.1% |

| 비동의 딥페이크 포르노 등 유해 가능성 있는 딥페이크를 호스팅하는 플랫폼 금지 | 71.8% |

| 딥페이크에 대한 교육, 제작 규칙, 식별 방법 등 학교 교육 강화 | 69.3% |

| 비동의 딥페이크 제작·유포 수사 관련 법집행기관 교육 강화 | 69.1% |

| 플랫폼에 유해 딥페이크 수 및 대응 현황 보고 의무 부과 | 62.1% |

| 유해 딥페이크 생성 가능 앱 금지 | 60.8% |

| 유해 딥페이크 대응 실패 플랫폼 공개 명명 | 59.6% |

| 미디어 리터러시 교육 및 대국민 인식 캠페인 확대 | 51.1% |

| 딥페이크 대응 연구 자금 지원 확대 | 45.0% |

| 모르겠다 | 2.4% |

| 기타 | 1.1% |

| 해당 없음 | 0.4% |

| 온라인 딥페이크 확산 대응 불필요 | 0.3% |

주석(출처) 출처: Sippy, T. 외. "Behind the Deepfake: 8% Create; 90% Concerned: Surveying Public Exposure to and Perceptions of Deepfakes in the U.K.," 2024년 7월; 조사 기간: 2024년 5월 31일~6월 5일 온라인 실시, 영국 성인(18세 이상) 1,403명 대상, 인구통계(연령, 성별, 인종)별 대표성 확보; 응답자는 먼저 전체 딥페이크 인식 및 경험을 묻고, 별도로 소셜 미디어 플랫폼의 유해 딥페이크 대응 방안에 대한 의견 질문

2)생성 AI 통제 위한 추가 입법

현재 미국 의회에서는 ‘No Fakes Act’ 등 딥페이크 합성물 규제법을 비롯해, AI가 생성한 콘텐츠에 ‘이것이 합성물임을 표시’하도록 의무화하는 방안, 유명인 초상권 침해 금지 규정 강화 등 다양한 법안이 논의 중이다.

- 엔터테인먼트 업계·노동조합: 배우·가수의 목소리나 얼굴이 AI 모델로 무단 복제되어 광고 등에 활용되는 사례에 대응하기 위해, 추가 조항을 요구하는 목소리가 커지고 있다.

- 빅테크 규제 강화: 메타, 구글, 마이크로소프트 등 대형 기술 기업들은 이미 내부적으로 NCII 탐지 기술과 필터링 시스템을 강화하고 있지만, 이들에게 명확한 법적 책임을 부과하는 움직임도 가속화될 것으로 보인다.

딥페이크 포르노 영상에서 가장 많이 등장하는 직업군

| 직업군 | 비율 |

|---|---|

| 배우 | 58% |

| 뮤지션 | 30% |

| 모델 | 17% |

| TV 출연자 | 13% |

| 콘텐츠 크리에이터 | 12% |

| 유명 인사 | 8% |

| 영화감독 | 4% |

| 성노동자 | 3% |

| 작가 | 3% |

| 기자 | 3% |

출처: Han, Catherine, et al., “Characterizing the MrDeepFakes Sexual Deepfake Marketplace,” 2025년 1월. MrDeepFakes 사이트 내 42,986개 영상, 3,803명 인물(유명인 1,942명) 분석 결과. 유명인 95.3%는 여성

3) 국외 서버·다크웹 문제

모든 NCII가 미국 내 서버에서만 유통되는 것은 아니다. 서버 위치를 해외로 옮기거나, 다크웹 등 익명성이 높은 공간에서 운영되는 딥페이크 포르노 사이트는 여전히 단속이 까다롭다.

- 국제 공조 필요성: 향후 NCII 관련 글로벌 규제 협력, 데이터 이전 협약 등이 마련되지 않는다면, 법 효과가 제한적으로만 미칠 수 있다.

- 기술적 한계 극복: VPN, 토르(Tor) 등을 통해 접속하는 음지 사이트 추적은 쉬운 일이 아니다. 따라서 범정부 차원의 디지털 수사·추적 역량 강화도 필수로 여겨진다.

결론

‘테이크 잇 다운(Take It Down)법’은 온라인 공간에서 벌어지는 대표적인 디지털 범죄, 즉 비동의 친밀 이미지(NCII)의 생성·유포 문제에 대한 미국 연방 차원의 첫 강력 대응책이다. 특히 딥페이크 기술이 만들어 낸 ‘가짜 음란물’ 피해가 폭증하는 현실 속에서, 이 법이 제시하는 48시간 이내 삭제 의무와 민·형사 처벌 규정은 과거보다 훨씬 직접적인 피해자 구제 수단이 될 것으로 기대된다.

물론 검열 오남용이나 사생활 침해, 거짓 신고 남용 등 여러 우려가 제기되는 만큼, 시행 과정에서 정교한 보완책과 기술적·법적 체계가 함께 마련되어야 한다. 그럼에도 불구하고, 이번 법의 통과와 발효로 인해 “피해자가 자신의 이미지를 통제할 수 있는 기본권”이 확실히 보장되기 시작했다는 점에서 의의가 크다. 앞으로 연관 법안인 ‘No Fakes Act’ 등 추가 입법이 어떻게 전개되고, 글로벌 차원의 공조가 어떻게 이뤄질지에 따라, 딥페이크와 NCII 규제의 실질적 효과가 결정될 것이다.

결국 이 모든 변화는 두 가지 방향성—피해자의 권리 보호와 기술 발전의 악용 방지—사이를 어떻게 균형 있게 이룰 것인가에 달려 있다. 생성 AI 시대가 가속화되는 현실 속에서, ‘테이크 잇 다운 법’은 디지털 공간에서의 인권·초상권 보호에 있어 중요한 전환점이 될 가능성이 높다.

![[보도자료]Kocowa, 유럽 진출 1년 성과](https://storage.googleapis.com/cdn.media.bluedot.so/bluedot.kentertechhub/2025/07/d4i5qa_202507142153.png)

![[Report]Inclusion & Equity Report 2025 by WGA](https://storage.googleapis.com/cdn.media.bluedot.so/bluedot.kentertechhub/2025/05/dza9ol_202505310259.png)