[M&E 2025]Will major studios embrace AI as a creator?(25년 메이저 스튜디오가 AI를 창작자로 인정하는 해)

무안 제주항공 사고로 희생되신 고인들의 명복을 빕니다. 갑작스런 사고로 사랑하는 이들을 잃어버린 유가족 분돌에게도 진심어린 위로의 말씀을 전합니다. 하지만 어떤 말로도 이 분들의 상실감을 채우긴 어려울 것 같습니다.

2025년 첫 뉴스레터는 지금도 믿고 싶지 않은 충격적 재난에 대한 슬픔으로 어렵게 시작합니다.

Our thoughts and prayers are with the families of the victims of the Muan Jeju Air crash. I would like to extend my heartfelt sympathies to the bereaved families who lost their loved ones in the sudden accident. However, no words can fill the pain of their loss.

Our first newsletter of 2025 begins with grief over a shocking disaster that we still don't want to believe.

크로스보더 엔터테인먼트 테크 뉴스 미디어&스튜디오 K엔터테크허브는 새로운 해의 시작을 알리는 첫 글을 보민했습니다. 오랜 생각 끝에 우리를 강타할 엔터테인먼트 테크놀로지 키워드를 소개하는 방식으로 새해를 맞기로 했습니다.

2025년 첫 번째 엔터테인먼트 테크 화두는 '스튜디오와 생성AI'입니다. 디즈니, 워너브러더스디스커버리(WBD) 등 100년 콘텐츠 스튜디오들이 생성AI를 언제 받아들이는 시점은 우리의 미래를 진달하는데 매우 중요합니다.

저는 레거시 할리우드가 AI를 창작자로 맞이하는 시점을 올해(2025년)라고 생각합니다. 그럼 첫 번째 글을 엽니다.

엔터테인먼트 테크는 오디언스를 확장하고 콘텐츠에 부가치를 높이는 기술이다. 지금 최고 엔터테인먼트 테크 기술은 단연 생성AI다.

지난 2024년 AI는 이미 현재가 됐다. 음악, 문학, 영화, TV, 메디컬 등 AI가 쓰이지 않는 곳은 없다. 그러나 생성 AI도입을 인해 가장 많은 변화가 예상됐던 미디어/엔터테인먼트 산업은 변화를 두려워하고 있다.

KEntechHub, a cross-border entertainment tech news outlet and studio, is kicking off the new year with a bang. After much thought, we've decided to ring in the new year by introducing you to the entertainment technology buzzwords that will take our world by storm.

Our first entertainment tech buzzword for 2025 is studios and generative AI. When Disney, Warner Bros. Discovery (WBD), and other centennial content studios embrace generative AI will be critical to our future.

I believe the time for legacy Hollywood to embrace AI as a creator is this year (2025), which opens the first installment.

Entertainment tech is about expanding audiences and adding value to content. The top entertainment tech right now is generative AI.

In 2024, AI is already here. Music, literature, movies, TV, healthcare, there's nothing that AI isn't used for. However, the media and entertainment industry, which was expected to be the most disrupted by the introduction of generative AI, is afraid of change.

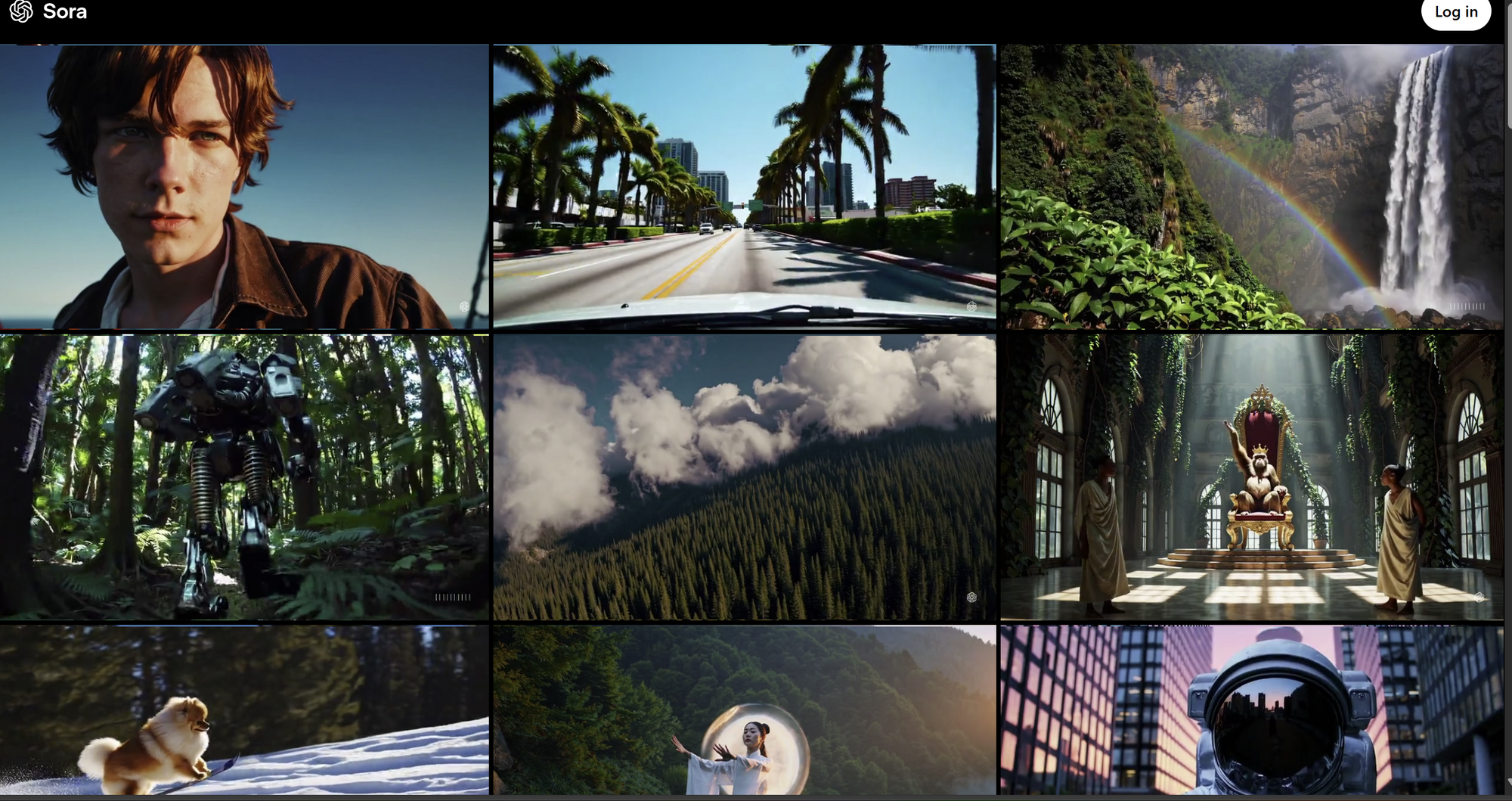

2024년 오픈AI가 소라를 내놓고 메타와 구글도 비디오 AI 대열에 합류했다.

AI스타업 런웨이(Runway)가 간단한 텍스트로 비디오를 만들 수 있는 젠3(Gen3)를 출시했지만 메이저 스튜디오들은 관망했다.

PC에서 몇 마디 문장을 가지고 영상을 만드는 시대가 왔다

하지만, 디즈니, 워너브러더스디스커버리 등 전통 미디어들은 이 영상을 사용하기에는 부족하다는 데 동의하고 있다 AI생성물의 퀄리티와 저작권의 불확실성 때문이다. 2024년 생성AI가 비디오 산업을 흔들었지만, 이를 비즈니스로 받아들인 곳이 없었던 셈이다.

그렇다면 2025년 달라질 것인가?

K엔터테크허브는 생성AI에 회의적이었던 레거시 스튜디오들의 생각에 군열이 올 것으로 믿고 있다. 2025년은 '스튜디오 AI'의 원년이 될 것이다.

KEntechHub, a cross-border entertainment tech news outlet and studio, is kicking off the new year with a bang. After much thought, we've decided to ring in the new year by introducing you to the entertainment technology buzzwords that will take our world by storm.

Our first entertainment tech buzzword for 2025 is studios and generative AI. When Disney, Warner Bros. Discovery (WBD), and other centennial content studios embrace generative AI will be critical to our future.

I believe the time for legacy Hollywood to embrace AI as a creator is this year (2025), which opens the first installment.

Entertainment tech is about expanding audiences and adding value to content. The top entertainment tech right now is gen AI.

In 2024, AI is already here. Music, literature, movies, TV, healthcare, and more are all areas where AI is used. However, the media and entertainment industry, which was expected to be the most disrupted by the introduction of generative AI, is afraid of change.

In 2024, OpenAI released Sora, and Meta and Google joined the ranks of video AI.

AI startup Runway launches Gen3, which can create videos from simple text, but the major studios wait.

The time has come to make videos from a few words on your PC

However, traditional media companies such as Disney and Warner Bros. Discovery agree that the footage is not good enough to use, due to the quality of AI-generated content and copyright uncertainty. In 2024, generative AI disrupted the video industry, but no one has embraced it as a business.

Will 2025 be different? KEntertechHub believes that legacy studios that were skeptical of generative AI will come around. 2025 will be the year of 'studio AI'.

‘생성AI의 퀄리티’와 ‘AI저작권 문제(Quality of Gen AI and AI Copyright Issues)

2024년 2월 오픈AI가 비디오 생성AI 소라(Sora)를 공개했을 때 많은 사람들이 큰 충격을 받았다.

일부 언론에서는 당장 할리우드의 작업 프로세스가 바뀔 것으로 예상하기도 했다. 그러나 이런 인상적인 모델도 할리우드의 보수성을 뚫기 어려웠다.

결과물이 통제가 되지 않고(Lack of controllability) 캐릭터와 사물, 환경의 일관성도 부족했다.

프리미엄 콘텐츠를 지향하는 할리우드의 눈눞에는 맞지 않았다.

버라이어티는 “폐색, 변형, 잘못된 해부학(occlusions, morphing and wrong anatomy) 등 시각적 불규칙성(hallucinations)이 여전하기 때문에 비디오 AI는 할리우드를 '대체' 할 준비가 되지 않았다”고 주장했다.

물론 비디오AI도 가만 있지 않았다.

2024년 12월 초 오픈된 구글 딥마인드 베오 2(DeepMind’s Veo 2)의 AI 포토리얼리즘은 상당히 인상적이다. 딥마인드는 베오2가 4K급 화질 콘텐츠를 만들낼 수 있다고 공개했다.

그러나 제어 가능성(controllability)은 여전히 숙제다. 소라와 베오 2도 출력물에서 여전히 환각 현상(hallucinations)이 나타난다. 이런 환각은 최소화할 수 있다고 해도 현재 기술로는 완전히 사라지게 할 수 없다.

할리우드 스튜디오들은 이런 슬롯머신과 같은 작업 환경을 신뢰하지 않는다.

When OpenAI unveiled its video creation AI, Sora, in February 2024, many people were shocked.

Some expected it to immediately change Hollywood's work processes.

But even this impressive model proved difficult to break through Hollywood's conservatism.

The result was a lack of controllability and a lack of consistency between characters, objects, and environments. It didn't fit Hollywood's eye for premium content.

"Video AI isn't ready to 'replace' Hollywood because visual irregularities - occlusions, morphing and wrong anatomy - and hallucinations still persist," Variety argued.

Of course, video AI hasn't been idle. The AI photorealism of Google's DeepMind's Veo 2, which opened in early December 2024, is quite impressive.

DeepMind says it can create 4K-quality content, but controllability is still an issue. Sora and Beo 2 still suffer from hallucinations in their output. While these hallucinations can be minimized, they can't be completely eliminated with current technology.

Hollywood studios don't trust these slot machine-like working environments.

걸림돌이었던 AI시대 저작권

사실 더 중요한 건 저작권이다. AI를 둘러싼 법적 불확실성은 도입을 주저하게 만드는 주요 원인 중 하나다.

AI를 둘러싼 저작권 문제는 다양한 문제를 발생시킨다.

AI가 만든 콘텐츠가 저작권을 침해했는 지에 대한 문제와 만약 저작권법을 위반했다면 언저 어느 단계에서 침해 했는지도 모호하다. AI를 둘러싼 저작권 문제는 전방위적이다.

저작권이 없는 콘텐츠로 학습된 AI모델도 저작권을 침해하는 동영상을 만들 수 있다.

이런 AI에 대한 불안감은 작업 환경에서 AI 도입을 주저하게 만든다.

2024년 5월 HarrisX가 실시한 조사에 따르면 미디어 및 엔터테인먼트 종사들은 저작권을 생성AI 사용의 가장 큰 걸림돌 중 하나(27%)로 꼽았다. 이는 의사 결정권자이거나 종업원 모두 같았다.

It's actually more about copyright. The legal uncertainty surrounding AI is one of the main reasons for hesitant adoption.

Copyright issues surrounding AI raise a variety of issues.

It's unclear whether AI-generated content infringes copyright, and if so, at what stage. The copyright issues surrounding AI are multifaceted.

Even AI models trained on non-copyrighted content can create videos that infringe copyright.

This fear of AI can make people hesitant to adopt it in the workplace.

A May 2024 HarrisX survey found that media and entertainment workers cited copyright as one of the biggest barriers to using generative AI (27%). This was the same for both decision makers and employees.

아직은 사전 시각화 단계에서 사용

미디어. 엔터테인먼트 분야에서 AI가 쓰이지 않는 것은 아니다.

법적 문제가 해결되기 전까지 스튜디오는 최종 단계가 아닌 사전 시각화(In the pre-visualization) 단계에서 AI비디오 생성 기술을 사용하는 경우가 많다. 또 대부분 주요 스튜디오들은 AI 콘텐츠를 참고 자료로만 사용하도록 제한하고 있다.

하지만, 미디어 산업 역시 생성AI에 주요 자리를 내어줄 가능성은 여전히 있다.

스튜디오 의사결정권자들은 비디오 생성AI의 현장 사용이 가능하다고 판단되면 사람이 아닌 컴퓨터에 작업을 맡길 가능성이 크다. 자료 그림(B롤). 인서트 샷, 보충 촬영(Pick up shot), 재연, 배경 등 AI 영상 콘텐츠가 쓰일 수 있는 곳은 상당히 많다.

특히, 비디오 생성AI의 힘은 ‘상상력을 넓혀주는 데’있다. 비디오 생성AI는 불가능한 장면을 가능하게 한다. 비디오 AI 모델은 카메라나 VFX로는 불가능한 '영상'을 현실화 할 수 있다. 품질이 문제지만, 상상력은 이미 인간 수준이다. 이런 모든 과정을 AI가 담당하는 ‘AI스튜디오’도 등장했다.

Still in the pre-visualization phase

It's not that AI isn't being used in media and entertainment.

Until the legal issues are resolved, studios are often using AI video generation technology in the pre-visualization stage, not the final stage.

Most major studios have also limited the use of AI content to reference material only.

However, there is still potential for the media industry to give generative AI a major role. Once studio decision-makers realize that video generation AI can be used in the field, they're more likely to entrust the work to computers rather than humans.

Source illustration (B-roll). Insert shots, pick up shots, reenactments, backgrounds, and more are just a few of the many places AI video content can be used.

In particular, the power of video-generated AI is in its ability to "stretch the imagination. Video gen AI makes the impossible possible.

Video AI models can realize "footage" that is impossible with cameras or VFX. Quality is an issue, but imagination is already at the human level. AI studios have also emerged where AI is in charge of all these processes.

스튜디오의 모든 관심은 파인 튜닝(Fine Tuning)에

스튜디오들은 여전히 AI를 무겁게 받아들이고 있다. 다른 산업 영역에서 AI를 도입해 비용을 줄이거나 생산성을 획기적으로 높이는 사례들이 나타나자 조바심을 내고 있다. 현재는 엔터테인먼트 테크 사업의 가장 중심에 AI가 있는 것이 맞다.

때문에 할리우드 스튜디오들은 자신들에게 맞는 AI모델을 찾기 위한 여정에 나섰다. 바로 비디오 생성 모델을 자신들의 TV나 영화 콘텐츠에 최적화 되도록 맞추는 미세 조정(Fine Tuning)하는 작업이 진행 중이다.

2024년 7월 런웨이가 최신 동영상 모델 업데이트인 Gen-3의 알파 버전을 출시한 이후 할리우드 스튜디오를 집중 공략했다. 새로운 솔루션을 경험하는 기회로 삼았다.

런웨이는 2024년 9월 라이언스게이트와 파트너십을 맺고 스튜디오 및 영화 제작자가 내부에서 사용할 독점 비디오 모델을 개발하겠다고 발표했다. 스튜디오의 영화, TV 콘텐츠 라이브러리에 최적화된 맞춤 기술(fine-tuned)을 제공하는 것이다. 소유한 콘텐츠 IP로 전속 동영상 모델을 훈련시키는 미세 조정이 할리우드 전반에 확산되고 있다.

파인 튜닝의 장점은 아직 체감되지 않았다.그러나 AI가 만드는 파인 튜닝 공식이 완성된다면 놀라운 변화를 경험할 수 있을 것으로 보인다. 스튜디오는 자신들의 팬이나 시장에 최적화된 콘텐츠를 제작하고 투자하기 더 쉬워진다. 그리고 이른바 ‘스튜디오의 성공 방정식’을 학습한 AIㅍ 인 튜닝은 라이선스 콘텐츠보다 시장 실패에 더 안전할 수 있다.

Studios' attention is all on fine tuning

Studios are still taking AI with a grain of salt. They're nervous because they've seen other industries use AI to reduce costs or dramatically increase productivity. Right now, AI is at the center of the entertainment tech business.

That's why Hollywood studios have embarked on a journey to find the right AI model for them. They're in the process of fine-tuning video generation models to optimize them for their TV and movie content.

Since July 2024, when Runway released the alpha version of Gen-3, our latest video model update, we've been targeting Hollywood studios. They took the opportunity to experience the new solution.

In September 2024, Runway announced a partnership with Lionsgate to develop a proprietary video model for internal use by studios and filmmakers.

The idea is to deliver technology that is fine-tuned for the studio's library of film and TV content. Fine-tuning, the practice of training proprietary video models with owned content IP, is spreading across Hollywood.

The benefits of fine-tuning have yet to be realized, but when the AI-powered fine-tuning formula is perfected, it could be transformative. It will be easier for studios to create and invest in content that is optimized for their fans and markets. And AI-powered fine-tuning, having learned the so-called "studio success equation," could be more resistant to market failure than licensed content.

메이저 스튜디오는 왜 AI 도입을 주저하는가?

지난해(2024년) 언론사나 소규모 스튜디오는 생성AI 기업과 잇달아 라이선스 계약을 했다.

하지만, 주요 스튜디오는 아직까지 공개적으로 AI 모델 학습을 위한 콘텐츠 라이선스 계약을 체결한 곳은 없다. 계약을 보류하는 이유는 다양하다. 대체로 AI도입 꺼렸던 사유는 두 개 정도로 모인다.

먼저 선례가 부족하다. 대부분 스튜디오들은 AI 학습용으로 쓰이는 자신들의 콘텐츠 가치가 얼마나 되는 지 못한다. 공정한 거래가 어떻게 구성되는지도 알 수 없다.

스튜디오가 AI 학습용으로 콘텐츠를 제공할 권리를 가졌는지도 불분명하다. 또 상당수 스튜디오들은 널리 쓰이는 일반 기능이 아닌 콘텐츠에 대한 비디오 모델을 파인 튜닝하는 등 특화된 기능을 가지길 원한다.

2025년 AI엔터테인먼트 시장의 관전 포인트는 ‘어떤 메이저 스튜디오가 AI와 먼저 계약하는 지’이다.

이 과정에서 칼리페 네트웍스(Calliope Networks)와 같은 AI개발자를 위한 콘텐츠 유통 플랫폼(최근 Protege가 인수하여 미디어 데이터 부문 Protege Media가 됨)이 허브가 될 수 있다.

AI 데이터 플랫폼 허브는 영화, TV 및 크리에이터의 고품질 콘텐츠를 모아 이를 원하는 AI 개발자와 라이선스 계약을 비공개로 주선해 준다.

올해는 AI를 이용한 딥페이크(Deepfake) 범죄가 더욱 기승을 부릴 것으로 전망된다.

기술 고도화에 따라 배우에서부터 유명 TV출연자, 크리에이터에 이르기까지 이름, 이미지, 초상, 목소리(name, image, likeness and voice, NILV)를 도용당하는 사례가 늘고 있다.

Why are major studios hesitant to adopt AI?

In the last year (2024), media companies and smaller studios have signed a number of licensing deals with generative AI companies.

However, no major studio has yet publicly signed a deal to license content to train AI models. The reasons for this are varied. In general, there are two main reasons for their reluctance.

First, there's a lack of precedent. Most studios don't know how much their content is worth when it's used to train AI. They also don't know what a fair deal looks like.

It's also unclear whether studios have the rights to provide content for AI training. Many studios also want to have specialized capabilities, such as fine-tuning video models for their content, rather than generalized capabilities that are widely available.

The big question for the AI entertainment market in 2025 is which major studio will sign on first.

Content distribution platforms for AI developers like Calliope Networks (recently acquired by Protege to become Protege Media, the media data arm of Protege) could become hubs in this process.

An AI data platform hub could be a movie,

| 대상 연예인 | 발견 시기 | 딥페이크/생성형 | 형태 | 의도 | 설명 |

|---|---|---|---|---|---|

| 케이티 페리, 리한나, 레이디 가가, 두아 리파 | 2024년 5월 | 생성형 | 이미지 | 예술적, 허위정보 | 실제로 참석하지 않은 메트 갈라 행사의 AI 이미지가 X에서 확산됨 |

| 제니 오르테가, 사브리나 카펜터 | 2024년 3월 | 생성형 | 이미지 | 홍보, NCII | 미성년자 오르테가와 20대 초반 카펜터의 "누디파이" 이미지가 키프로스 기반 RichAds사의 AI 탈의 앱 광고로 페이스북 등에 등장 |

| 바비 알토프 | 2024년 2월 | 딥페이크 | 영상 | NCII | 6개월간 유포된 알토프의 얼굴이 합성된 음란물이 X에서 바이럴되어 24시간 동안 게시됨 |

| 션 "디디" 콤스, 스티브 하비, 덴젤 워싱턴, 비숍 T.D. 제이크스 | 2024년 1월 | 딥페이크 | 영상 | 허위정보 | 수백만 조회수를 기록한 AI 생성 가짜뉴스와 조작된 영상을 유포한 유튜브 채널 12개 이상 발견 |

| 테일러 스위프트 | 2024년 1월 | 생성형 | 이미지 | NCII | 텔레그램 그룹에서 시작된 스위프트의 노출 AI 이미지가 X로 확산 |

| 테일러 스위프트, 마사 스튜어트, 오프라 윈프리 외 | 2023년 12월 | 딥페이크 | 영상, 음성 | 홍보, 사기 | 가짜 Le Creuset 주방용품 경품 이벤트를 홍보하는 AI 음성과 립싱크 영상이 페이스북과 틱톡에 등장 |

| 톰 행크스 | 2023년 10월 | 딥페이크 | 영상, 음성 | 홍보 | 치과 치료 플랜을 홍보하는 행크스의 얼굴과 목소리가 담긴 인스타그램 광고 |

| 게일 킹 | 2023년 10월 | 딥페이크 | 영상, 음성 | 홍보 | 다이어트 제품을 홍보하는 킹의 얼굴과 목소리가 담긴 인스타그램 광고 |

| 미스터비스트 (지미 도널드슨) | 2023년 10월 | 딥페이크 | 영상, 음성 | 사기 | 가짜 아이폰15 Pro 경품 이벤트를 홍보하는 도널드슨의 틱톡 영상 |

| 드레이크, 위켄드 | 2023년 4월 | 딥페이크 | 음악 | 예술적 | TikTok 사용자 Ghostwriter977이 제작한 'Heart on My Sleeve' 딥페이크 음성 노래가 저작권 침해로 스트리밍 서비스에서 삭제됨 |

| 스칼렛 요한슨, 엠마 왓슨 | 2023년 3월 | 딥페이크 | 영상 | 홍보, NCII | 중국 원더쉐어사의 Ufoto Limited가 개발한 딥페이크 앱 광고가 SNS에서 발견됨 |

| 교황 프란치스코 | 2023년 3월 | 생성형 | 이미지 | 예술적 | Midjourney로 제작된 흰색 패딩을 입은 교황의 AI 이미지가 바이럴됨 |

| 여성 트위치 스트리머들 (Sweet Anita, Maya Higa 외) | 2023년 1월 | 딥페이크 | 영상 | NCII | 한 남성 스트리머의 실수로 접속이 발각된 음란물 사이트에서 여성 스트리머들의 딥페이크 영상이 발견됨 |

| 마크 러팔로 | 2022년 10월 | 딥페이크 | 영상, 음성 | 사기 | 러팔로로 사칭한 사기꾼이 74세 만화가 치카에 이데씨를 속여 50만 달러를 편취 |

| 톰 크루즈 | 2021년 8월 | 딥페이크 | 영상, 음성 | 패러디 | VFX 전문가 크리스 움이 딥페이스랩으로 제작한 @deeptomcruise 틱톡 계정의 패러디 영상 |

출처: Variety Intelligence Platform, 2024년 11월; AI Incident Database (AIID)의 AI 관련 피해 사례 중 엔터테이너 대상 사례 발췌

사기성 광고와 딥페이크를 이용한 비동의적 친밀한 이미지(non consensual intimate imagery, NCII)를 제작도 증가하고 있다.

합의 없이 만들어진 디지털 초상권을 찾아내는 비즈니스도 커지고 있다. 동의 받지 않은 디지털 초상권을 검색하는 로티(Loti , Digital Likeness Protection for Public Figures)는 몸값이 높아지고 있다. 2024년 9월 30일 로티는 700만 달러를 투자 받았다고 밝혔다. Loti - Online Protection for Public Figures

The creation of non-consensual intimate imagery (NCII) using ready-made ads and deepfakes is also on the rise.

There is also a growing business in identifying digital likenesses created without consent. Li, who searches for non-consensual digital likenesses, is facing increasing ransoms.

디지털 복제본 사용을 추적하고 추적하는 솔루션 필요

유명인들의 AI 초상권(Authorized uses of talent AI likeness)의 승인도 늘기 시작했다.

영화, TV, 게임 또는 애니메이션 스튜디오, 스포츠 리그 및 브랜드도 AI를 이용한 디지털 복제의 범위는 다양하다. 이에 유명인들의 디지털 복제를 추적할 수 있는 시스템이 매우 중요하다.

특히, 콘텐츠가 여러 플랫폼으로 확산될 때 특정 파트너가 자산을 어떻게 사용하는지 추적하고 추적할 수 있어야 한다. 지금까지 업계는 멀티 플랫폼에 대응할 수 있는 강력하고 상호 운용 가능한 증명 봇기술과 통합된 표준을 개발하는 데 중점을 뒀다.

Need a solution to track and trace the use of digital copies

Authorized uses of talent AI likenesses of celebrities are also starting to grow. Film, TV, game or animation studios, sports leagues, and brands are also using AI for a wide range of digital likenesses. This is why a system to track digital replication of celebrities is so important.

In particular, it's important to be able to track and trace how assets are used by specific partners when content is spread across multiple platforms. To date, the industry has focused on developing robust, interoperable proof-of-authenticity bot technology and integrated standards that can cope with multi-platforms.

열기 식은 AI 챗봇

2024년 여러 AI 기업들은 셀럽이나 크리에이터와 협력해, 대화형 AI(conversational AI)를 잇달아 공개했다.

AI로 유명인들의 인격을 학습해 ‘실제 그들과 대화하는 것과 같은 콘텐츠 경험(content experiences)에 나선 것이다 대화형 AI는 주로 유명인의 목소리나 페르소나으로 구현되며 앱이나 LLM 기반 챗봇을 커스터마이징하는 방식으로 개발되고 있다.

아콰피나(Awkwafina), 존 시나(John Cena), 주디 덴치(Judi Dench) 등 5명의 유명인 목소리를 페이스북과 같은 소셜 미디어에 제공하는 메타의 AI챗봇, 고인이 된 유명 배우 4명의 목소리를 제공하는 오디오북에 제공하는 엘레븐 랩스(ElevenLabs)의 아이코닉 보이스(Iconic Voices) 등이 대표적이다.

대화형 AI챗봇의 등장은 유명인들에게는 새로운 수익을 안겨주고 시청자에게는 대규모로 개인화된 콘텐츠를 제공할 수 있었다. 하지만, 유명인이나 캐릭터 기반 챗봇은 개발자가 위험한 결과를 제한하더라도 사용자가 권리 보유자가 사용자를 완전히 통제할 수 없는 수 없기 때문에 위험이 존재한다.

의인화된 챗봇(personified chatbots)의 또 다른 위험은 AI와 사용자의 과도한 애착 관계 형성이다. 애착으로 인해 일부 사용자, 특히 젊은이들이 스스로 목숨을 끊었기도 했다. 유명인들의 인격을 학습해 AI채팅을 제공하는 캐릭터AI(Character.ai)와 같은 회사는 소송 위험에 노출되고 있다.

AI chatbots have cooled off

In 2024, several AI companies unveiled a series of conversational AIs, working with celebrities and creators. AI learns the personalities of celebrities to create content experiences that feel like you're actually talking to them.

Conversational AI is often implemented in the voice or persona of a celebrity and is developed by customizing apps or LLM-based chatbots.

Examples include Meta's AI chatbot that provides five celebrity voices, including Awkwafina, John Cena, and Judi Dench, for social media like Facebook, and ElevenLabs' Iconic Voices, which provides the voices of four deceased actors for audiobooks.

The rise of conversational AI chatbots has created new revenue streams for celebrities and personalized content at scale for audiences. However, celebrity- or character-based chatbots pose risks, as users may not be fully controlled by the rights holder, even if developers limit the risky outcomes.

Another risk with personified chatbots is the development of an over-attachment between the AI and the user.

This attachment has led some users, especially young people, to take their own lives. Companies like Character.ai, which trains celebrities' personalities to provide AI chats, are exposed to the risk of lawsuits.

세계 최대 혁신 축제 CES2025에서 생성AI와 엔터테인먼트 조명

오는 1월 7일부터 10일까지 미국 네바다 라스베이거스에서 열리는 세계 혁신 IT축제 CES(Consumer Electronic Show)에서도 AI와 엔터테인먼트, 미디어, 콘텐츠가 만나는 지점에 대해서 논의한다. 엔터테인먼트 AI세션이 대거 준비되어 있다.

CES에서 엔터테인먼트, 미디어, 콘텐츠에 집중하는 세미나는 크게 3개다. ‘디지털 헐리우드’, ‘CES 버라이어티 엔터테인먼트 서밋’, ‘Modev AI house’다.

Spotlighting generative AI and entertainment at CES 2025, the world's largest innovation festival

The Consumer Electronic Show (CES), the world's largest celebration of innovation and technology, is taking place January 7-10 in Las Vegas, Nevada, USA, and the intersection of AI and entertainment, media, and content will be discussed. There are plenty of sessions on AI in entertainment.

There are three main seminars at CES that focus on entertainment, media, and content. They are Digital Hollywood, CES Variety Entertainment Summit, and Modev AI house.

2025년 1월 6일 오전 10시 아리아 1층(조슈아8)에서 열리는 ‘The Hollywood Trajectory: Generative AI Timeline: 2025 – 2030’는 버라이어티의 앤드류 월렌스테인(Andrew Wallenstein)이 진행을 맡고 노키아(Nokia), 오토데스크(AutoDesk), 액센츄어(accenture) 등에서 전문가가 참석해 향후 5년 간의 AI 발전 맵을 탐구한다.

버라이어티가 1월 8일 여는 ‘엔터테인먼트 서밋(Entertainment Summit)’ 에서도 AI는 핵심 화두다. 11시 15분부터 45분까지 개최되는 ‘ Succeeding With AI and Entertainment’ 서밋은 Fox, PBS키즈, 틱톡, UCLA 미디어 엔터테인먼트 수석 디렉터가 토론에 참여한다. 세션은 “엔터테인먼트 업계가 AI의 미래를 이해하고 있는 지금, 오늘날의 리더들은 AI를 가장 잘 활용하고 성공할 수 있는 방법을 어떻게 평가하고 있을까. 크리에이티브 업계가 AI에 대한 책임감 있는 접근 방식과 성장의 균형을 맞추는 방법”을 살펴본다.

모디브(Modev)가 개최하는 The AI House는 1월 8일 열리는 AI 집중 이벤트다. LVCC 노스홀(N261)에서 열린다. AI로 문을 열고 오후 3시부터 3시 40분, ‘엔터테인먼의 미래(The Future of Entertainment)’라는 이름이 세미나가 이어진다.

현장에서는 콘텐츠 제작부터 개인화된 경험에 이르기까지 AI가 엔터테인먼트 산업을 어떻게 변화시키고 미디어 참여와 향유 방식을 재정의하는 지에 논의된다. K엔터테크허브도 지디넷,DRI,메디온테크와 함께 1월 8일 엔터테크의 미래를 담은 ‘2025 퓨처테크’ 컨퍼런스를 오후 3시(미국 서부 시간) 연다. 엔터테크, 메디컬테크, AI와 우리의 미래 등이 논의된다. CES2025 현장에 방문하는 분들은 꼭 한번 둘러볼 필요가 있다.

The Hollywood Trajectory: Generative AI Timeline: 2025 - 2030, on January 6, 2025 at 10 a.m. on Level 1, Aria (Joshua 8), will be moderated by Variety's Andrew Wallenstein and feature experts from Nokia, AutoDesk, accenture, and more, exploring the map of AI development over the next five years.

AI is also a key topic at Variety's Entertainment Summit on January 8th. The "Succeeding With AI and Entertainment" summit, which runs from 11:15 a.m. to 11:45 a.m., will feature discussions from senior directors of media and entertainment at Fox, PBS Kids, TikTok, and UCLA. The session will explore "As the entertainment industry understands the future of AI, how are today's leaders evaluating how to best utilize AI and succeed, and how the creative industry is balancing growth with a responsible approach to AI."

The AI House, presented by Modev, is an AI-focused event on January 8th. It will be held in the LVCC North Hall (N261). It will open with AI, followed by a seminar called "The Future of Entertainment" from 3:00 to 3:40 p.m.

On-site discussions will focus on how AI is transforming the entertainment industry, from content creation to personalized experiences, and redefining the way we engage with and enjoy media. K-EntechHub, along with GiddyNet, DRI, and MedionTech, will also host the "2025 FutureTech" conference on January 8 at 3:00 p.m. (U.S. West Coast time) to discuss the future of entrepreneurship. Topics such as entech, medtech, AI and our future will be discussed. If you're going to be at CES 2025, it's definitely worth checking out.

LVCC 등에서 열리는 전시회에서도 ‘콘텐츠와 엔터테인먼트 미디어’가 AI를 만나 새로운 차원으로 진화하는 순간을 포착한다. 특히, 최근 스트리밍 서비스의 중심이 되고 있는 TV가 AI를 품으면서 진화하는 현장을 그린다.

LG는 AI 최적화된 화질과 음질을 제공하는 QNED evo TV 시리즈를 공개할 예정이다. AI가 대화의 명확성을 높이고 2채널 오디오를 9.1.2 채널의 몰입형 경험으로 변환하는 기술이 소개된다.

Exhibitions at LVCC and elsewhere will capture the moment when 'content and entertainment media' meet AI and evolve to new heights, especially as TVs, which have recently become the center of streaming services, embrace AI.

LG will unveil its QNED evo TV series, which offers AI-optimized picture and sound quality. The technology will showcase how AI enhances the clarity of conversations and transforms two-channel audio into a 9.1.2 channel immersive experience.

![[Report]Inclusion & Equity Report 2025 by WGA](https://storage.googleapis.com/cdn.media.bluedot.so/bluedot.kentertechhub/2025/05/dza9ol_202505310259.png)

![[Report]라이선싱엑스포 2025 심층 보고서](https://storage.googleapis.com/cdn.media.bluedot.so/bluedot.kentertechhub/2025/05/srjw47_202505191926.png)